Gli algoritmi sono spesso visti come strumenti neutrali e imparziali, ma in realtà nascondono profonde implicazioni sociali ed etiche che influiscono sulla nostra vita quotidiana. In questo articolo esploreremo come gli algoritmi, inclusi quelli utilizzati nell’ambito dell'”intelligenza artificiale”, contribuiscano alle disuguaglianze sociali, influenzino il nostro comportamento e limitino la nostra libertà. Questo non significa demonizzare l’IA,ma imparare a riconoscerne il valore e a utilizzarla consapevolmente come co-piloti, garantendo un equilibrio che prevenga distorsioni nel processo decisionale. Il pericolo algograzia è reale così come una di dittatura di algoritmi e iA.

Pericolo algograzia dittatura di algoritmi e iA: disuguaglianze sociali

Gli algoritmi, che spesso appaiono come strumenti neutrali e imparziali, nascondono in realtà una nuova forma di lotta di potere. In passato, la divisione sociale era tra proletari e borghesi; oggi, la frattura è tra chi possiede i dati e chi ne subisce le conseguenze. Le grandi aziende tecnologiche detengono una quantità incredibile di dati sugli individui, dati che vengono raccolti tramite ogni nostra interazione digitale. Chi possiede questi dati detiene il vero potere, poiché ha la capacità di influenzare e manipolare comportamenti e decisioni. Al contrario, chi fornisce i dati – noi, gli utenti – è sempre più soggetto a questa manipolazione. Le implicazioni di questo nuovo squilibrio di potere sono profonde: mentre un piccolo gruppo di attori accumula ricchezza e influenza, la massa degli utenti resta vulnerabile, esposta a un sistema che si nutre delle loro informazioni personali per generare profitto.

Inoltre, l’analfabetismo funzionale e l’analfabetismo di ritorno aggravano ulteriormente questa disuguaglianza. Chi non è in grado di comprendere testi complessi o chi ha perso tali capacità con il tempo, è svantaggiato in una società dominata da algoritmi e informazioni automatizzate. Questi individui, meno preparati a interpretare le informazioni fornite dagli algoritmi, sono più vulnerabili alla manipolazione e meno in grado di partecipare attivamente alle decisioni che influenzano la loro vita. Così, la disuguaglianza non riguarda solo l’accesso ai dati, ma anche la capacità di comprenderli e utilizzarli.

Il controllo invisibile degli algoritmi

Dietro ogni click, ogni scelta e ogni contenuto che vediamo online, c’è un algoritmo che lavora per modellare la nostra realtà. Gli algoritmi decidono cosa vediamo nei feed dei social media, quali risultati di ricerca ci vengono mostrati, quali pubblicità riceviamo. Questo controllo invisibile, apparentemente banale, ha in realtà un impatto enorme sulle nostre vite. Questi sistemi determinano quali informazioni ci raggiungono, influenzando le nostre decisioni e modellando le nostre preferenze, arrivando persino a definire chi siamo nel mondo digitale. Il rischio è quello di perdere la nostra autonomia di pensiero: invece di esplorare liberamente il mondo delle informazioni, ci ritroviamo chiusi in un guscio costruito su misura per noi dagli algoritmi, che limitano la nostra esposizione a idee diverse e contrastanti. Questo fenomeno si traduce in echo chambers e filter bubbles, dove siamo esposti solo a contenuti che confermano le nostre opinioni, alimentando i nostri pregiudizi cognitivi e riducendo il confronto con prospettive diverse. Questa prigione digitale è invisibile, ma non per questo meno reale. La conseguenza di questo meccanismo è una polarizzazione sociale sempre più marcata, che limita l’esplorazione di nuove idee e ostacola una visione più ampia e critica del mondo

L’illusione della libertà digitale

Molti di noi credono che l’accesso a Internet sia sinonimo di libertà, ma è davvero così? Gli algoritmi che orchestrano le nostre esperienze digitali sono progettati per massimizzare l’interazione e il coinvolgimento, spesso a scapito della nostra autonomia. Siamo pedine in un gioco più grande, in cui le nostre interazioni sono pianificate per mantenere la nostra attenzione il più a lungo possibile su piattaforme specifiche. Questo controllo si basa sulla creazione di filter bubbles ed echo chambers, dove i contenuti che ci vengono proposti sono selezionati per rinforzare i nostri pregiudizi e interessi preesistenti. La conseguenza è che la nostra visione del mondo si restringe e la nostra capacità di esplorare prospettive diverse diminuisce.

Questa manipolazione ci fa credere di avere il controllo delle nostre azioni online, quando in realtà siamo guidati da scelte preimpostate, progettate per indirizzarci verso determinati contenuti e comportamenti. Gli algoritmi non solo raccolgono dati per prevedere i nostri comportamenti, ma li manipolano per influenzare le decisioni che prendiamo, mettendo in pericolo la nostra autonomia. La vera libertà digitale implica la capacità di esplorare e scegliere consapevolmente cosa fare delle nostre informazioni, ma questa libertà sembra essere sempre più lontana dalla nostra esperienza quotidiana.

I guru della rete e il servilismo verso l’algoritmo

Invece di sfidare il sistema, molti cosiddetti “guru della rete” preferiscono spiegare agli utenti come adattarsi alle regole imposte dagli algoritmi di piattaforme come Meta e TikTok. Questo atteggiamento non fa altro che perpetuare il servilismo verso un sistema che appiattisce la cultura, la creatività e il pensiero critico. Gli algoritmi di queste piattaforme sono progettati per massimizzare l’interazione e il coinvolgimento, premiando contenuti che garantiscono una partecipazione elevata, piuttosto che promuovere l’innovazione o l’espressione artistica autentica. Come dimostrato da diversi studi, tali algoritmi impongono criteri rigidi come l’ottimizzazione degli hashtag, la lunghezza dei video e l’orario di pubblicazione, ganci, costringendo i creatori a uniformarsi a modelli prestabiliti per ottenere visibilità.

Invece di cercare alternative o proporre modi per sfidare il controllo algoritmico, questi esperti si limitano a insegnare come ottenere più visualizzazioni o like, giocando secondo le regole imposte dalle grandi piattaforme. Questo approccio non solo limita la nostra capacità di esprimere liberamente la nostra creatività, ma riduce anche il valore delle interazioni online a meri numeri. Gli utenti e i creatori finiscono per trovarsi intrappolati in una cultura algoritmica che premia la conformità e l’omologazione, annullando l’elemento distintivo e creativo che dovrebbe caratterizzare l’arte e il pensiero critico.

Inoltre, queste dinamiche creano un circolo vizioso: mentre i creatori si adattano per massimizzare l’engagement, gli utenti vengono esposti a contenuti sempre più simili e prevedibili, in un loop che limita la diversità delle esperienze digitali. Gli algoritmi, con la loro capacità di prevedere e manipolare i comportamenti, stanno progressivamente riducendo il pensiero critico e la riflessione, alimentando un servilismo che svuota di significato il contenuto stesso e appiattisce la cultura.

La solitudine digitale

Viviamo in un’epoca di costante iperconnessione, ma, paradossalmente, ci sentiamo sempre più isolati. Le interazioni online, che sembrano accorciare le distanze tra le persone, spesso finiscono per allontanarci. Gli algoritmi, infatti, plasmano le nostre esperienze digitali selezionando i contenuti a cui siamo esposti, e, senza che ce ne accorgiamo, ci confinano in uno spazio virtuale che riflette esclusivamente le nostre preferenze. Questo ci separa dalle prospettive altrui, impoverendo la nostra comprensione del mondo reale. Il risultato è un progressivo distacco dalla realtà condivisa e un rafforzamento di un isolamento che si manifesta a livello emotivo e sociale. Questo fenomeno sottolinea il pericolo dell’algograzia: una dittatura degli algoritmi e dell’IA che limita la nostra esposizione a idee diverse, rafforzando la frammentazione e l’isolamento.

Le nostre interazioni digitali, inoltre, sono spesso caratterizzate da una superficialità che le rende incapaci di soddisfare il nostro bisogno di connessioni autentiche. Senza la presenza di segnali non verbali, come il linguaggio del corpo o il tono della voce, le conversazioni virtuali diventano fredde e prive di empatia, lasciandoci insoddisfatti e soli nonostante la moltitudine di contatti disponibili. La tecnologia, che dovrebbe favorire la connessione, paradossalmente alimenta la disgregazione sociale, creando un ambiente digitale frammentato e privo di un vero contatto umano.

Monologhi digitali e la perdita del confronto

La comunicazione nell’era digitale sta subendo cambiamenti radicali, allontanandosi dal dialogo genuino verso una modalità di scambio più monologante. Sui social media e piattaforme come WhatsApp, la conversazione è spesso ridotta a messaggi frammentari, dove non si cerca realmente di dialogare ma solo di esporre il proprio punto di vista. Questa dinamica riduce la profondità delle interazioni e trasforma le discussioni in dichiarazioni unilaterali. Diversi studi indicano che la mancanza di scambio costruttivo, unita all’assenza di feedback immediato e non verbale, sta portando alla scomparsa del dialogo autentico.

In questo contesto, i monologhi digitali creano un ambiente in cui il confronto e la costruzione collettiva di idee vengono sostituiti da dichiarazioni egocentriche. L’assenza di interazione autentica non solo impoverisce la comunicazione, ma amplifica anche la frammentazione sociale. Senza un vero confronto, ogni individuo rimane chiuso nelle proprie convinzioni, con il rischio che la società diventi sempre più divisa e atomizzata.

Censura algoritmica e limitazione del dibattito

Gli algoritmi che regolano il contenuto delle piattaforme digitali, inclusa l’intelligenza artificiale, agiscono come una forma di censura preventiva, influenzando la libertà di espressione prima ancora che il pensiero possa svilupparsi pienamente. Questi sistemi, programmati per moderare enormi quantità di dati, finiscono per limitare la varietà di opinioni esposte. L’ideologia Woke e la cancel culture sono potenziata dall’IA, che permette una rimozione rapida e sistematica dei contenuti, silenziando le voci discordanti e riducendo il dibattito a un flusso uniforme e controllato.

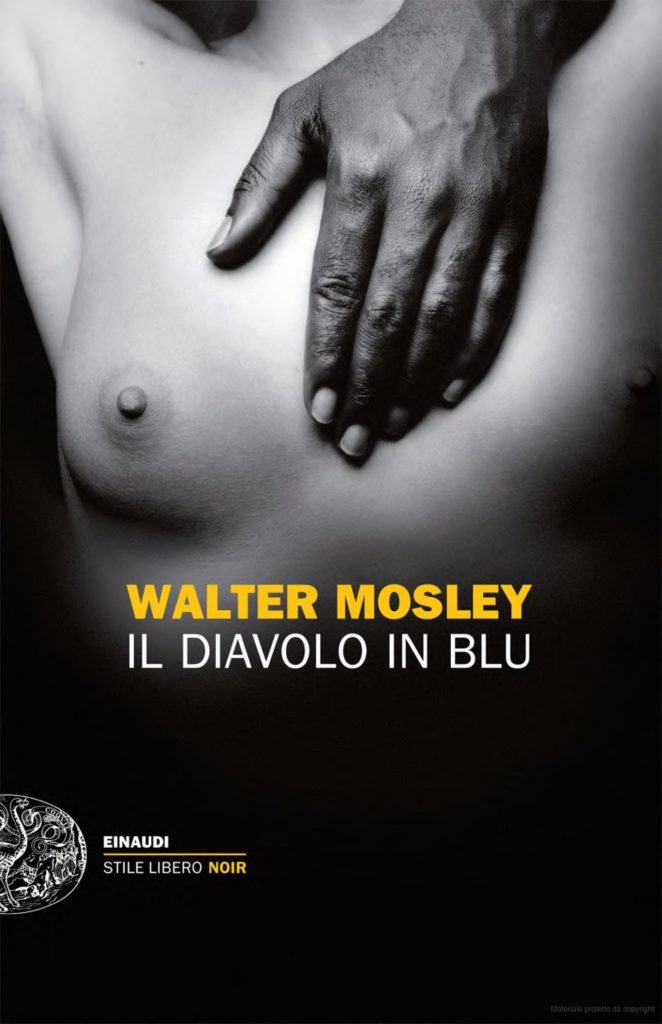

L’uso della tecnologia algoritmica e dell’IA per moderare i contenuti porta a una standardizzazione delle opinioni, soffocando la diversità di pensiero. La conseguenza è un impoverimento del dibattito pubblico, dove le idee non conformi vengono filtrate o eliminate ancor prima di essere discusse. In questo modo, l’IA non solo gestisce l’informazione, ma contribuisce anche a definire i confini del discorso pubblico ma anche di cosa è corretto o non corretto vedere, censurando opere d’arte e letterarie di enorme valore.

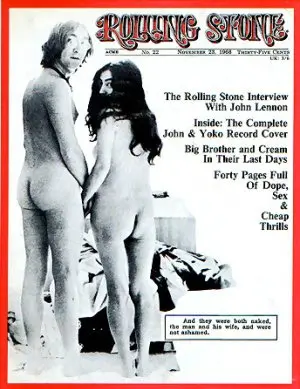

Personalmente ho subito più volte censura e sono stato cacciato da Meta più volte per periodi lunghi fino a un mese per aver postato ad esempio la copertina del libri Il Diavolo In Blu (di Enaudi) o copertine di album di Jimi Hendrix o Rolling Stone, oggi praticamente introvabili anche su google. Per non parlare di opere d’arte come “l’origine del mondo” che possono piacere o meno ma che non possono essere censurate. Stessa cosa mi è accaduta con molti articoli o post su meta dove semplicemente mi chiedevo se l’ideologia Woke potesse essere pericolosa.

Bias e disuguaglianze radicate nei dati

Gli algoritmi, spesso considerati strumenti neutrali, riflettono i bias e le disuguaglianze della società da cui derivano i dati su cui sono costruiti. In questo modo, l’IA può amplificare pregiudizi già esistenti, perpetuando discriminazioni sistemiche. Ad esempio, nel settore della giustizia, strumenti come COMPAS hanno mostrato tendenze discriminatorie verso gruppi minoritari, etichettandoli come più propensi a recidivare. Allo stesso modo, nel reclutamento, sistemi di IA hanno penalizzato le donne, come nel caso di Amazon, dove gli algoritmi favorivano inconsapevolmente i candidati maschili.

Anche se gli algoritmi vengono presentati come oggettivi, la realtà è che operano su dati imperfetti. Senza regolamentazioni e un’adeguata supervisione, rischiano di perpetuare le disuguaglianze, anziché ridurle.

Rischio di manipolazione e disinformazione

Gli algoritmi e le tecnologie legate all’intelligenza artificiale offrono straordinarie opportunità, ma possono anche essere sfruttati per manipolare l’opinione pubblica e diffondere disinformazione. I deepfake rappresentano una minaccia crescente alla fiducia nelle informazioni. Attraverso queste metodologie, è possibile creare contenuti falsi estremamente realistici che possono essere utilizzati per influenzare elezioni, screditare figure pubbliche o amplificare la diffusione di fake news su larga scala.

I deepfake, sviluppati con l’uso di tecniche di apprendimento automatico come le Generative Adversarial Networks (GAN), generano immagini, video o audio falsificati che sembrano autentici. Questo potere tecnologico può essere sfruttato in modo dannoso, destabilizzando le istituzioni o diffondendo sfiducia nelle informazioni pubbliche. Questi scenari sono già stati utilizzati in contesti politici e sociali, contribuendo alla disinformazione e alla polarizzazione sociale.

In parallelo, gli algoritmi che regolano i contenuti sui social media promuovono informazioni in base agli interessi degli utenti, facilitando la rapida diffusione di notizie false, spesso basate su contenuti emotivamente coinvolgenti. Questo crea un ambiente in cui la disinformazione si diffonde più velocemente delle notizie verificate, compromettendo la capacità del pubblico di discernere i fatti dalla finzione. Gli algoritmi, se non gestiti correttamente, possono così compromettere la qualità del dibattito pubblico e minare i processi democratici.

Etica nella regolamentazione dell’IA

Mentre la tecnologia avanza rapidamente, le normative faticano a tenere il passo. La regolamentazione dell’IA è ancora frammentata e spesso inefficace, lasciando spazio a numerosi rischi etici. È essenziale sviluppare standard globali che affrontino le questioni etiche legate all’uso dell’intelligenza artificiale, garantendo che questa tecnologia sia utilizzata in modo responsabile e a beneficio di tutti. Senza un quadro normativo solido, il rischio è che l’IA venga utilizzata in modi che amplificano le disuguaglianze e ledono i diritti delle persone. La sfida per il futuro è quella di creare un equilibrio tra l’innovazione tecnologica e la tutela dei diritti umani, assicurando che l’IA venga sviluppata e utilizzata nel rispetto della dignità umana.

Il pericolo algograzia è reale così come è possibile una dittatura di algoritmi e iA

Il mondo degli algoritmi, lungi dall’essere un semplice strumento tecnologico, ha un profondo impatto sociale ed etico. Le disuguaglianze create dal controllo dei dati, la manipolazione invisibile delle nostre decisioni, e i rischi di censura e disinformazione sono tutti aspetti che richiedono una profonda riflessione e interventi urgenti. Mentre la tecnologia continua a evolversi, dobbiamo assicurarci che lo faccia in modo che rispetti i diritti e la dignità degli individui e al di fuori di ogni ideologia come, già scritto in precedenza, la deriva Woke. Solo con una regolamentazione etica adeguata e una consapevolezza critica possiamo sperare di sfruttare i benefici degli algoritmi senza cadere vittime delle loro insidie.

Leggi anche

- Elon Musk ci ricasca e diffonde un video fake su Kamala Harris manipolato dall’intelligenza artificiale

- 5 segreti dell’intelligenza artificiale che nessun giornalista o corso on line racconta chiaramente

- AI ACT: la regolamentazione dell’intelligenza artificiale

- Messaggi subliminali nell’era dell’intelligenza artificiale che diffondono Hitler

- Intelligenza Criminale: l’IA abbraccia la carriera criminale

- LaMDA l’algoritmo di google ha un’anima?

- I pericoli dell’ideologia Woke e del politicamente corretto per la libertà di pensiero

- L’estetica dimenticata: l’impatto dei selfie e dei filtri sulla percezione di sé

- La Disney scopre che cultura woke, bigottismo e politicamente corretto non pagano

- Techneosofia: alla ricerca dell’uomo nell’era digitale